Londres – A Meta, dona do Facebook e do Instagram, passará a exigir que imagens e vídeos produzidos com uso de inteligência artificial generativa para propaganda política sejam sinalizados, como forma de limitar o efeito dos “deepfakes” e imagens alteradas que enganam os usuários das redes sociais.

A empresa não proibiu o uso desse tipo de conteúdo, mas a partir de 2024 postagens com imagens criadas con IA ganharão uma etiqueta para alertar o público, e também a indicação de quem pagou pelo anúncio.

A decisão, anunciada via Twitter pelo presidente de assuntos globais da Meta, Nick Clegg, entra em vigor no ano em que pelo menos 16 países realizarão pleitos nacionais, incluindo os EUA, onde Donald Trump pretende voltar à Casa Branca.

Presidente da Meta é ex-político britânico

Clegg, que assumiu a linha de frente nas comunicações mais importantes da Meta em 2022 quando o CEO da rede social, Mark Zuckerberg, ficou com a imagem desgastada depois de seguidas denúncias sobre as práticas da empresa, é um ex-político britânico que chegou a ser vice-primeiro-ministro do país no governo de David Cameron.

Ele disse:

“No ano que vem, os anunciantes que veiculam anúncios sobre questões sociais, eleições e política na Meta terão que divulgar se a imagem ou o som foram criados ou alterados digitalmente, inclusive com IA, com a finalidade de mostrar pessoas reais fazendo ou dizendo coisas que não fizeram ou disseram.”

No passado, Mark Zuckerberg demonstrava menos inclinação para esse tipo de restrição, tendo chegado a afirmar que os políticos deveriam ter alguma margem de tolerância para fazerem alegações falsas e que os telespectadores e eleitores deveriam decidir como responsabilizá-los.

Mas as pressões cada vez maiores por regulamentação da IA e responsabilização das plataformas digitais pela desinformação e influência negativa sobre a democracia podem ter feito a Meta mudar de ideia.

Na semana passada, o presidente Joe Biden revelou ter ficado “estarrecido” ao se ver em um vídeo deepfake durante a cerimônia em que anunciou um amplo decreto para regulamentar a IA.

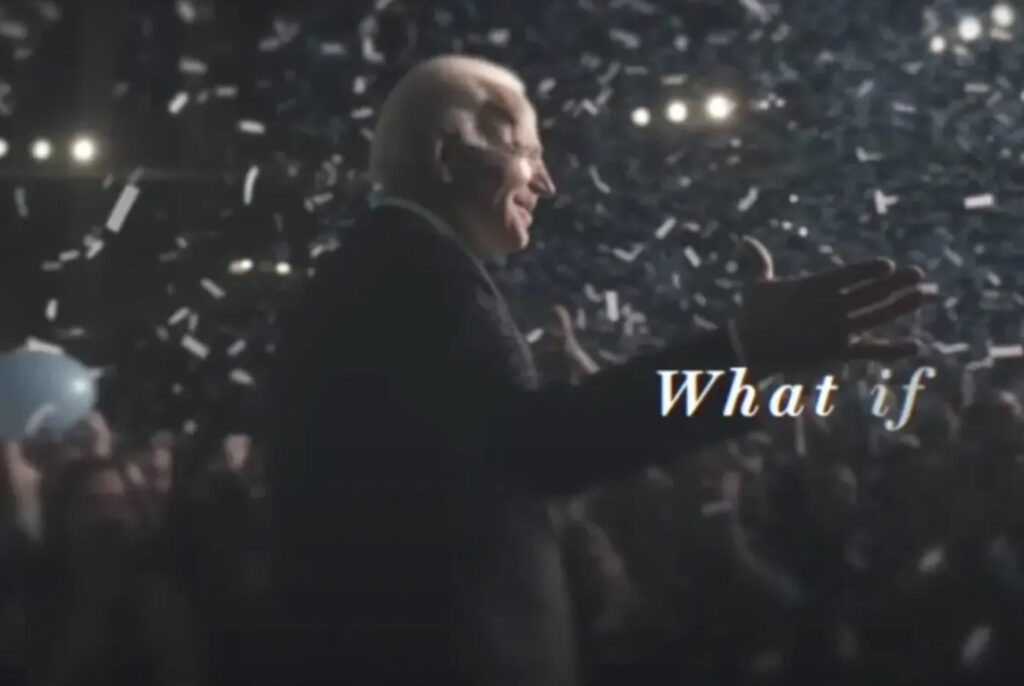

As preocupações eleitorais se justificam. Tão logo Biden anunciou a intenção de concorrer à reeleição, o Partido Republicano colocou no ar nas redes sociais um vídeo intitulado “Beat Biden”, construindo um cenário catastrófico caso ele seja reeleito, com imagens produzidas por IA simulando uma comemoração da vitória.

O concorrente, Trump, também foi alvo de deepfakes simulando sua prisão.

Leia também | Imagens falsas de Trump preso em Nova York feitas para denunciar ‘deepfakes’ viralizam no Twitter

O que diz a nova política da Meta contra deepfakes

A Meta diz que os anunciantes no Facebook e Instagram terão que divulgar sempre que um anúncio sobre temas sociais e políticos, incluindo campanhas eleitorais, contiver uma imagem ou vídeo fotorrealista, ou áudio com som realista, que tenha sido criado digitalmente ou alterado para:

- Descrever uma pessoa real dizendo ou fazendo algo que não disse ou fez

- Retratar uma pessoa de aparência realista que não existe ou um evento de aparência realista que não aconteceu, ou alterar a filmagem de um evento real que aconteceu

- Descrever um evento realista que supostamente ocorreu, mas que não seja uma imagem, vídeo ou gravação de áudio verdadeira do evento

Leia também | Desinformação e IA: o medo é exagerado? Pesquisador de Oxford acha que sim

Os anunciantes não precisarão sinalizar alterações que não interfiram na informação que se deseja transmitir, como ajuste de tamanho de imagem, corte, correção de cor ou nitidez, “a menos que tais alterações sejam relevantes para a reivindicação, afirmação ou problema levantado no anúncio”.

A Meta informou que adicionará informações ao anúncio quando um anunciante relatar que o conteúdo foi criado ou alterado digitalmente.

Essas informações também aparecerão na Biblioteca de anúncios.

“Se determinarmos que um anunciante não divulga conforme exigido, rejeitaremos o anúncio e a falha repetida na divulgação poderá resultar em penalidades contra o anunciante”, diz a nova política.

No início da semana, a Meta também anunciou que restringiria os anunciantes políticos de usarem as ferramentas de publicidade de IA da própria empresa, que podem gerar planos de fundo, sugerir textos de marketing ou fornecer música para acompanhar vídeos.

A Microsoft está na mesma sintonia: uma ferramenta será oferecida gratuitamente para campanhas políticas permitindo aplicar uma espécie de marca d’água destinada a garantir aos usuários que o conteúdo é autêntico.

Leia também | Empregos, deepkafes, diversidade: como a IA pode afetar a reputação das empresas que não fizerem a coisa certa