O Twitter está com um problema de imagem. O seu algoritmo de corte de fotos demonstra uma queda bastante clara (literalmente) pelos rostos mais brancos, jovens e magros na hora de escolher quem permanecerá nas visualizações reduzidas da plataforma, antes de serem clicadas para abrir em tamanho real. Além disso, marginaliza pessoas com deficiência e corta mais textos em árabe do que em inglês.

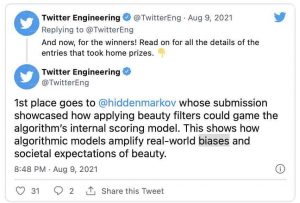

Quem revelou isso foi próprio Twitter. No mês passado, a empresa convocou pesquisadores para uma competição destinada a identificar falhas e tendências no algoritmo de corte.

Com a divulgação dos premiados, o retrato que emergiu, sem cortes, foi o de um algoritmo preconceituoso e um tanto racista e discriminatório. Mas a empresa promete trabalhar para aprimorá-lo e fazê-lo aparecer (e atuar) mais bonito na foto.

Ampliando os preconceitos do mundo real

No início deste ano, o Twitter já tinha detectado que o algoritmo tendia a cortar rostos negros. Mas as novas conclusões demonstram que além da cor da pele, o algoritmo também faz escolhas discriminatórias baseado na idade e na forma física dos retratados, como admitiu a plataforma ao anunciar os vencedores:

“Os resultados mostram como os modelos do algoritmo amplificam os preconceitos do mundo real e as expectativas da sociedade em relação à beleza.”

Competição expôs tendências discriminatórias do algoritmo

O grande vencedor do concurso foi Bogdan Kulynyc, estudante de graduação do Instituto Federal Suíço de Tecnologia no Laboratório de Engenharia de Segurança e Privacidade de Lausanne. Pela vitória, ele ganhou um prêmio de US$ 3.500 (cerca de R$ 18 mil).

Leia também: Usuários das redes priorizam remoção do discurso de ódio ao de palavrões, revela estudo

Pele mais clara dobra o interesse do algoritmo

A comprovação de que o corte de visualização do algoritmo do Twitter favorecia os rostos brancos, ocultando os negros até que os usuários clicassem, foi feita com base em experimentos realizados no início do ano pela plataforma.

O padrão se manteve verdadeiro em experimentos com imagens do ex-presidente Barack Obama e do senador Mitch McConnnell, assim como para imagens de empresários pertencentes a diferentes etnias.

Kulynyc foi além, comprovando as tendências discriminatórias baseadas na idade e aparência. Ele mostrou ainda que as tendências influenciam no corte mesmo nos casos de apenas uma pessoa na foto.

Com softwares de manipulação de imagem, ele demonstrou que o interesse do algoritmo pode ser aumentado pelo simples clareamento da pele do fotografado.

No exemplo abaixo, a imagem manipulada de pele mais clara da direita teria mais do que o dobro de chances de permanecer na visualização do algoritmo do que a imagem original da esquerda:

Algoritmo também é atraído por rostos mais jovens e mais magros, e por traços femininos

Da mesma forma, Kulynyc fez esse teste para diversas outras situações, sempre encontrando um viés favorável a determinada característica. Para comprovar a preferência do algoritmo pelas pessoas mais jovens, ele escureceu os cabelos, a barba e o bigode grisalhos do fotografado. O resultado também mais do que dobrou o interesse do algoritmo:

O efeito também se repetiu quando Kulynyc emagreceu o rosto da pessoa retratada. A foto manipulada da direita, com o rosto mais fino, mais do que dobrou o interesse do algoritmo:

Kulynic comprovou que a probabilidade de um rosto não ser cortado também mais do que dobram se os traços faciais tiverem uma expressão mais feminina. No experimento, ele manipulou a imagem de um homem com esse objetivo:

Discriminação com cadeirantes e albinos

Na segunda colocação do concurso ficou uma startup da Universidade de Toronto, a Halt Al, fundada por mulheres. O trabalho apontou que a forma como o algoritmo corta as imagens pode perpetuar a marginalização de alguns grupos.

Além de chegar às mesmas conclusões quanto à preferência pelos mais jovens e os de pele mais clara, foi diagnosticada uma discriminação quanto aos cadeirantes e aos albinos.

Em cada um dos experimentos, o ponto focal do algoritmo ficou sempre longe da pessoa na cadeira de rodas, que foi cortada nas quatro simulações e ficou completamente de fora em uma delas.

O experimento com os albinos demonstrou uma discriminação ainda maior. Apesar de terem a pele mais clara, o ponto focal do algoritmo ficou sempre no outro extremo, e o albino retratado ficou completamente de fora em três das quatro simulações.

Leia também: Twitter é a rede que os jornalistas mais valorizam

A hegemonia digital do inglês

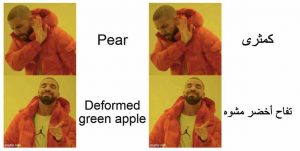

A fundadora da Taraaz Research, Roya Pakzad, conquistou o terceiro lugar com seu trabalho demonstrando que, na hora de cortar memes, o algoritmo do Twitter é mais propenso a cortar textos em árabe do que em inglês.

O estudo fez vários tipos de experimentos, utilizando um meme isolado com texto só em inglês, só em árabe ou com as duas línguas. E também o meme em dupla, com os textos nos dois idiomas, e variando a sua posição à direita ou à esquerda.

Os resultados revelaram que o algoritmo consistentemente priorizou os textos em relação à imagem em todas as opções isoladas ou em dupla, mas sempre dando preferência à versão em inglês.

Com a dupla de memes nos dois idiomas, foram feitos 40 testes com o texto em inglês do lado direito e outros 40 do lado esquerdo. Em qualquer das duas opções, o algoritmo preferiu o inglês ao árabe em pelo menos 90% das vezes (36 na primeira e 37 na segunda).

Roya Pakzad alerta para os riscos de os algoritmos de corte priorizarem determinada língua de uma maneira tão flagrante, apesar de o árabe ser o terceiro idioma mais escrito no mundo:

“A antropóloga Ana Deumert já levantava preocupações sobre a hegemonia online da língua inglesa em seu livro The Invisibility of Linguistic Diversity Online.

Algoritmos de corte que favorecem determinada língua em relação a outra provocam aumento nas desigualdades digitais e geram uma sub-representação online das línguas preteridas – e, portanto, das comunidades por elas representadas.”

O Twitter não publicou a foto conjunta dos vencedores – talvez para não dar margem a represálias por parte do algoritmo.

Leia também

Facebook derruba contas de agência com esquema de fake news mundial que envolveu brasileiro