Maior canal de exibição de vídeos no mundo e fonte de notícias para um quarto da população dos Estados Unidos, o YouTube se pronunciou ontem (25/8) sobre suas iniciativas para conter a desinformação na plataforma, diante de questionamentos que se intensificaram após a tomada do Afeganistão pelo Talibã.

Em texto publicado no blog oficial, a empresa defende sua moderação de conteúdo e afirma que abusos ao remover vídeos devem ser evitados.

Provocado por artigo no jornal The Washington Post, que acusa a empresa de se manter “na sombra” de Facebook e Twitter quando o assunto é se responsabilizar pelo conteúdo exibido, o executivo Neil Mohan, chefe de produto da empresa, detalhou a percepção do YouTube sobre o assunto, defendendo que mais do que remover vídeos, é necessário administrar bem o conteúdo que fica online.

Leia também: YouTube bane emissora de TV por uma semana por desinformação sobre Covid-19

Segundo o Post, a companhia, que pertence ao Google, mantém uma aparente tática de deixar os colegas Facebook e Twitter enfrentarem a opinião pública, e só depois tomar uma atitude, observando as repercussões que recaem sobre as outras redes sociais, frequentemente cobradas.

Um ex-funcionário do YouTube ouvido pelo jornal disse, sob condição de anonimato, que a postura mais “lenta” da empresa é uma mistura da estrutura enorme do Google, que gera decisões mais demoradas, e também uma certa estratégia. Menos cobrada politicamente, a plataforma de vídeos evita o desgaste, deixando outras empresas na fogueira.

Em momentos críticos, YouTube deixou Facebook e Twitter agirem primeiro

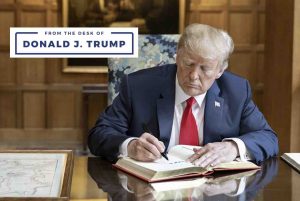

Episódios como o banimento de Donald Trump das redes ilustram a postura do YouTube. Facebook e Twitter tomaram à frente excluindo o ex-presidente dos EUA, e a plataforma de vídeos seguiu o caminho, só que uma semana depois, quando o assunto já estava “frio”. Na crise do Afeganistão aconteceu o mesmo.

Uma das possibilidades para essa cobrança menor seria a natureza da plataforma. Enquanto no Facebook e no Twitter formadores de opinião se manifestam rotineiramente sobre temas polêmicos, em posts com grande impacto e potencial viral, no YouTube isso acontece com menos intensidade.

Sobre o combate à desinformação, o executivo do YouTube coloca desta maneira: “Não é apenas o que removemos, mas como tratamos todo o conteúdo que deixamos [no ar], que nos dá o melhor caminho a seguir.”

Mohan exibe o dilema que se mostrou em outro fato envolvendo as Big Techs na última semana, quando o Facebook foi exposto por não revelar um relatório que mostrava uma notícia verdadeira, porém usada amplamente contra a vacinação da Covid-19, como o post mais visto pelos americanos na plataforma, no primeiro trimestre.

Focar em remoção apenas leva redes sociais ao papel de tiranos e censores

A moderação de conteúdo desinformativo é mais sutil e não pode ser baseada apenas em remoções de conteúdo, pois, como mostra o exemplo do Facebook, muitas vezes a notícia em si não é falsa.

Mohan afirma que o algoritmo do YouTube prioriza qualidade sobre popularidade, negando que a empresa esteja numa “busca cega” por mais cliques, e portanto por mais receita. Sobre a exclusão de conteúdo da plataforma, o executivo argumenta:

“Uma abordagem excessivamente agressiva em relação às remoções também teria um efeito negativo sobre a liberdade de expressão. As remoções são um instrumento contundente e, se usadas amplamente, podem enviar uma mensagem de que ideias controversas são inaceitáveis.”

Leia também: TikTok decide banir “desafio da caixa de leite” após ortopedistas apontarem risco de fraturas

Andy Stone, porta-voz do Facebook, ao tentar explicar por que a empresa omitiu um relatório que mostrava o alcance da desinformação e no trimestre seguinte exibiu os números quando receitas e desafios inocentes foram os mais acessados, ilustrou um pouco do que se coloca para as redes daqui em diante:

“A imprensa escreveu sobre o médico do sul da Flórida que morreu [após tomar vacina contra Covid-19]. Quando o legista divulgou a causa da morte, o Chicago Tribune anexou uma atualização à sua história original; o NYTimes não.

Teria sido certo remover a história do Times por ser uma informação errônea sobre aCovid? Claro que não. Ninguém está realmente sugerindo isso, e nem eu. Mas ilustra como é difícil definir desinformação.”

YouTube aposta em intervir em conteúdos após a versão oficial se estabelecer

O YouTube considera pouco a fatia de cerca de 18% do conteúdo postado na plataforma violar o código de conduta da rede social. Mohan afirma que, dos 10 milhões de vídeos removidos por trimestre, a maioria é censurada antes de chegarem a 10 visualizações. “Se nos concentrarmos apenas no que removemos, estaremos perdendo a enorme quantidade de conteúdo que as pessoas realmente veem”, afirma.

As eleições americanas são colocadas pelo executivo como exemplo da prática adotada hoje pelo YouTube. Antes de concluída a apuração, diversos vídeos afirmavam que havia manipulação, casos de votos rasgados e inúmeras acusações contra a credibilidade do pleito. A rede social manteve os vídeos no ar, e após os resultados oficiais, localizou e excluiu da plataforma conteúdo considerado desinformativo ou falso a respeito da votação.

O que as manifestações das big techs apontam é que, apesar de “todo mundo” fazer parte delas, elas não conseguem assumir o papel de controlar o mundo, com argumenta Mohan:

“Após eventos trágicos, como ataques violentos, surgem teorias a cada segundo sobre tudo, desde a identidade do atirador até o motivo. Nesses momentos, o que acontece no mundo também acontece no YouTube.”

Leia também

Influencer brasileiro é citado em caso internacional de fake news em posts pagos