Londres – A Meta, controladora do Instagram, pediu desculpas e disse ter corrigido o mecanismo de tradução automática que estava inserindo a palavra terrorista em posts de usuários palestinos na rede social.

Textos com as palavras palestino em inglês e “alhamdulillah” em árabe postados por usuários identificados com o emoji da Palestina apareciam na tradução automática como “Louvado seja Deus, os terroristas palestinos estão lutando pela sua liberdade”.

O problema foi apontado pelo site de tecnologia 404media no início da semana, a partir do alerta feito pelo usuário do TikTok YtKingKhan.

Desculpas da Meta após vídeo no TikTok

Ele mostrou em um vídeo como a tradução automática estava aparecendo em postagens com o emoji da bandeira da palestina.

Embora a Meta tenha avisado que corrigiu o problema imediatamente, o vídeo mostrou que diferentes combinações ainda estavam usando a palavra terrorista.

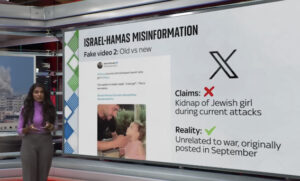

O problema é mais um capítulo das controvérsias e críticas às plataformas digitais pelo conteúdo relacionado à guerra entre o Hamas e Israel.

A União Europeia notificou as principais redes, cobrando explicações e medidas para conter a desinformação, e abriu um processo contra o Twitter.

Leia também | UE abre investigação contra Twitter/X por conteúdo da guerra e cobra medidas de outras redes

Antes do pedido de desculpas, a Meta já tinha sido acusada de censurar posts em defesa da Palestina e de programar os algoritmos para que esse conteúdo não fosse exibido.

Em comunicado, a empresa disse:

“Corrigimos um problema que causou brevemente traduções inadequadas do árabe em alguns de nossos produtos.

“Pedimos sinceras desculpas por isso ter acontecido.”

Meta explica medidas para conter conteúdo prejudicial

Em uma postagem de blog na quarta-feira, a proprietária do Facebook e do Instagram relatou ações adotadas após o início da guerra para lidar com o aumento de conteúdo prejudicial em suas plataformas.

A empresa afirmou que não está silenciando deliberadamente a voz de qualquer pessoa, e disse que elogios ao Hamas, que designa como uma “organização perigosa”, ou conteúdo violento e gráfico não é permitido.

A Meta admitiu que nesse processo “pode cometer erros” e pediu a quem se sentisse prejudicado para reportar ao canal de apelações.

Ela também disse que corrigiu um bug que impedia que vídeos e postagens de feed compartilhados novamente aparecessem corretamente nas histórias das pessoas no Instagram, “levando a um alcance significativamente reduzido” – mas disse que o problema não estava relacionado apenas a postagens sobre Israel e Gaza.

Leia também | Guerra Israel-Gaza: como serviços de checagem de fatos da imprensa ajudam a conter ‘desinformação galopante’