Em resumo

- Meta vem promovendo recurso de dublagem automática de vídeos no Instagram, mas ferramenta pode ser usada sem controle dos autores da imagem.

- Caso de clipes de entrevista do ator Luis Navarro no programa Provoca, da TV Cultura, é um exemplo de como os conteúdos podem ser mudados de idioma e contexto sem que os autores sequer saibam.

O ator Luis Navarro disse ter sido “assustador” ver clipes de sua entrevista a um programa da TV Cultura exibidos no Instagram em vários idiomas, com dublagem por IA perfeitamente sincronizada e sua própria voz. O episódio mostra a necessidade de questionar os limites: quem aprova, e quem assume a responsabilidade por possíveis distorções?

Uma conversa entre o ator brasileiro Luis Navarro e o jornalista Marcelo Tas, exibida na terça-feira (25) no programa Provoca, da TV Cultura, levantou um alerta sobre os rumos da mídia digital na era da inteligência artificial devido à dublagem feita por um recurso de IA do Instagram. Ele aparece falando em inglês e em outros idiomas, com sua própria voz, sotaque e sincronia labial.

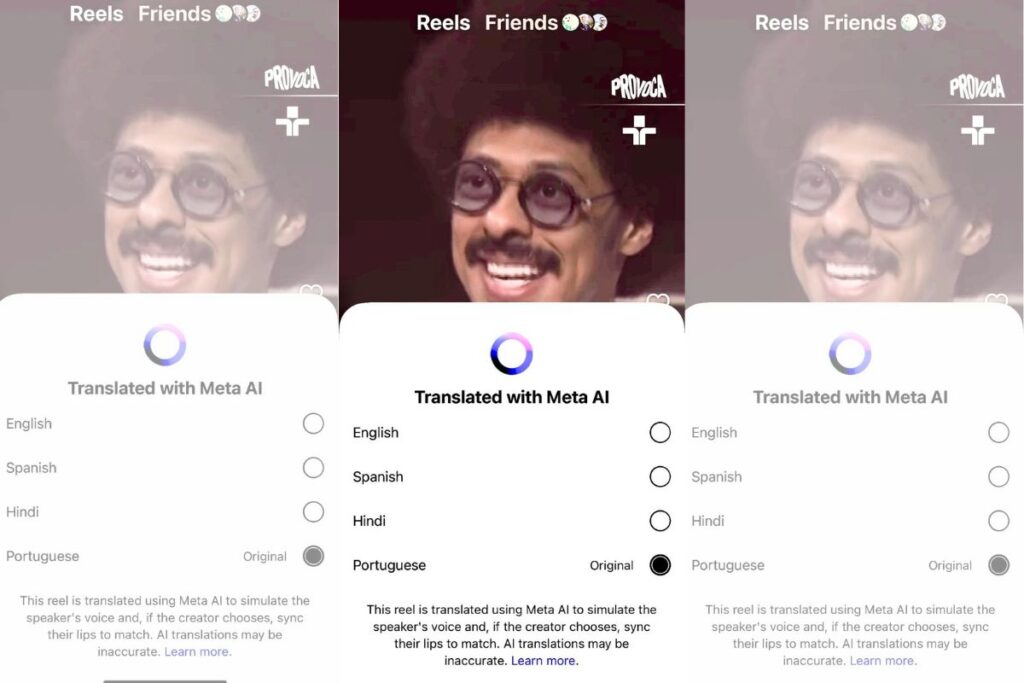

Clipes da entrevista postados na rede social apareceram dublados com precisão impressionante, dependendo de onde o usuário esteja ou o idioma que solicite na barra inferior. Só que nem Navarro nem a TV Cultura produziram ou autorizaram as dublagens.

Elas foram feitas por uma ferramenta de tradução, dublagem e lip-sync por inteligência artificial aplicada a vídeos em Reels, que a Meta vem anunciando. Segundo a companhia dona do Instagram, o recurso permite que criadores tornem seus conteúdos disponíveis em várias línguas sem regravar nada.

A voz, o tom e o ritmo são analisados, traduzidos e reconstruídos com sincronia labial nas novas versões, com suporte a inglês, espanhol, português e hindi, criando a impressão de que o vídeo sempre existiu em múltiplas edições.

A dublagem automática perfeita da IA do Instagram

Foi o que aconteceu com a entrevista. Neste vídeo Navarro apareceu falando em inglês, com sua própria voz, sotaque e sincronia labial, sem que tenha sido uma edição planejada.

O susto de Navarro — e o alerta sobre consentimento

Essa experiência, relatada por usuários e confirmada pelo ator envolvido, expõe uma mudança silenciosa: a transformação automática do conteúdo dependendo de quem o assiste e onde.

“Eu não sabia, achei realmente algo assustador. Parece que cada vez mais a humanidade se encaminha para o rumo mais fácil, onde o aprendizado não será mais necessário”, reagiu Navarro em conversa com o MediaTalks.

“O mais estranho foi o fato de não ter autorizado essa tradução. Até que ponto teremos controle sobre isso?”

Traduções automáticas mudam a própria noção de autoria

O que permanece nebuloso é até que ponto o criador controla esse processo. A dúvida é se a tradução é ativada por decisão consciente ou aplicada automaticamente conforme local ou idioma do espectador.

O relato do próprio artista, sem saber das versões multilíngues, sugere que a reconstrução pode ocorrer sem conhecimento ou consentimento.

Esse fenômeno redefine o conceito de autoria. O vídeo original e o vídeo consumido por cada público podem deixar de ser o mesmo. A plataforma de distribuição passa de intermediária a participante ativa na composição final.

Leia também | Em protesto contra nova lei britânica de IA, Paul McCartney grava música ‘silenciosa’

O dilema ético: conveniência ou credibilidade?

Para agências, marcas, emissoras e profissionais de comunicação, a consequência é concreta.

A confiança não depende apenas do que é dito, mas de como o conteúdo chega ao público. A mensagem pode ser remodelada no trajeto, com mudanças sutis, porém significativas, de idioma, tom e contexto.

Quando a tecnologia torna automática a adaptação da voz, do rosto e da língua, emergem também riscos de descontextualização, má interpretação e sensação de artificialidade.

Para além da conveniência, isso atinge o cerne da credibilidade e da integridade da comunicação.

Há benefícios claros em termos de alcance e acessibilidade. Mas é igualmente essencial questionar os limites: quem aprova as versões traduzidas? Quem assume a responsabilidade por possíveis distorções?

Na era da mídia global mediada por algoritmos, o que o espectador consome pode já não coincidir com o que foi produzido.

A distribuição deixou de ser ponte e passou a ser moldura. E, muitas vezes, uma coautora que toma decisões independentes.

Sobre a autora: Flávia Vígio é é jornalista pela PUC-RJ, liderou a comunicação de corporações internacionais como McDonald’s, HBO e Televisa/Univision no Brasil, América Latina, EUA e Europa. Estudou IA em Stanford e no MIT, e é fundadora de uma startup que usa a tecnologia para medir reputação corporativa.

Leia também | Dá para confiar na IA para notícias? Pesquisa da União Europeia de Radiodifusão e CEO do Google acham que não

Leia também | IA, celebridades, viés, privacidade online e respiração calmante: dicionário Cambridge destaca 8 palavras ‘em alta’ em 2025

Leia também | Quase ninguém percebe quando uma música é feita por IA – e a maioria das pessoas se incomoda com isso, mostra pesquisa

Leia também | Vibe coding, broligarchy, clanker: palavras do ano do Collins refletem IA e Big Techs nas nossas vidas

Leia também | Novo modo adulto do ChatGPT vem aí: especialista aponta riscos da IA erótica para jovens e mulheres